Đốt tiền cho API của OpenClaw xót quá? Thử ngay combo OpenClaw + Ollama chạy Local

OpenClaw là một framework tạo AI Agent mã nguồn mở cực kỳ xịn sò. Tải về và cài đặt thì chả tốn một cắc nào, nhưng đến lúc bạn thực sự xài nó, hãy chuẩn bị tinh thần nhìn số Token của mình bị đốt với tốc độ bàn thờ.

Chi phí của OpenClaw không chỉ đến từ mỗi cái câu trả lời của model lõi. Nó còn cộng dồn từ việc AI tự động đọc web, truy xuất bộ nhớ, tóm tắt dữ liệu, gọi tool (công cụ), và cả đống file workspace lẫn cấu hình bootstrap bị nhồi nhét vào system prompt. Một khi cửa sổ ngữ cảnh (context window) dài ra, tờ hóa đơn cuối tháng sẽ giáng cho bạn một cú trời giáng.

Thử chạy OpenClaw với Claude 3.5 Sonnet mà xem, một tháng sương sương 10 triệu token đầu vào và 10 triệu token đầu ra là bạn đã bay nhẹ gần cả trăm đô. Nếu bạn coi nó là một "nhân viên" Agent chạy 24/7, giao phó các task khó nhằn trên các model xịn, thì chuyện đốt vài ngàn đô một tháng là điều hết sức bình thường. Cứ nhìn việc OpenRouter tăng vọt lưu lượng xử lý token từ 6.4 nghìn tỷ lên 13 nghìn tỷ mỗi tuần là đủ hiểu.

Mục đích ban đầu là bắt AI làm thuê cho mình, kết cục là cống nạp hết tiền lương cho AI.

Vì chi phí mua Token trên Cloud quá mặn, nên việc mang toàn bộ hệ thống này về chạy ở Local (máy cá nhân) là một nước đi sáng suốt. Đây chính là lúc sự kết hợp giữa OpenClaw và Ollama trở thành cứu tinh.

Ollama sẽ gánh vác việc chạy các model mã nguồn mở như Llama, Mistral hay DeepSeek trực tiếp trên máy của bạn. Thế là tiền API API giảm thẳng về con số 0. Trừ việc quạt tản nhiệt của card màn hình sẽ rú to hơn một chút, thì chẳng có điểm trừ nào cả. Thêm nữa, toàn bộ dữ liệu mật và code của bạn đều được xử lý 100% tại local, không có bất kỳ thứ gì bị đẩy lên Cloud. Vừa kiểm soát được chi phí, vừa bảo mật tuyệt đối riêng tư.

Thực chiến: Chạy OpenClaw kẹp với Ollama ở Local

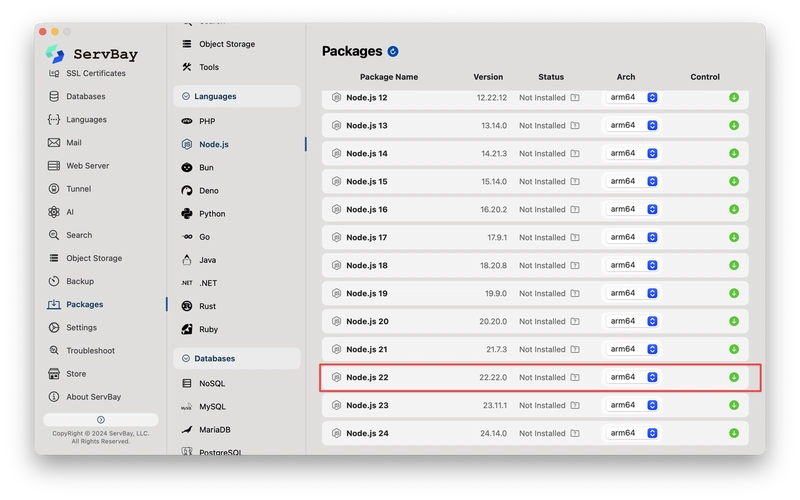

OpenClaw là một framework viết bằng Node.js, và nó yêu cầu bắt buộc môi trường phải là Node.js phiên bản 22 trở lên.

Đây là lúc bạn có thể cậy nhờ ServBay để deploy môi trường Node.js.

Đóng vai trò là một công cụ quản lý môi trường web dev ở local, ServBay xử lý việc quản lý nhiều phiên bản Node.js nhẹ tựa lông hồng. Thông qua giao diện UI cực kỳ trực quan, bạn có thể cài đặt môi trường Node.js chỉ với một cú click chuột và switch thẳng sang Node.js 22, bỏ qua hoàn toàn cái quá trình config biến môi trường bằng tay hay đánh lộn với các lỗi xung đột version.

Khi môi trường đã sẵn sàng, việc deploy OpenClaw chỉ tốn vài dòng lệnh đơn giản:

curl -fsSL https://molt.bot/install.sh | bash openclaw onboard --install-daemon

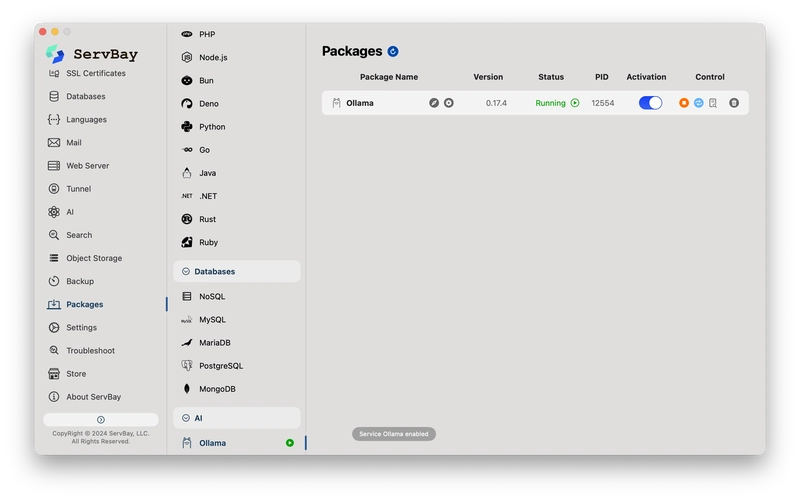

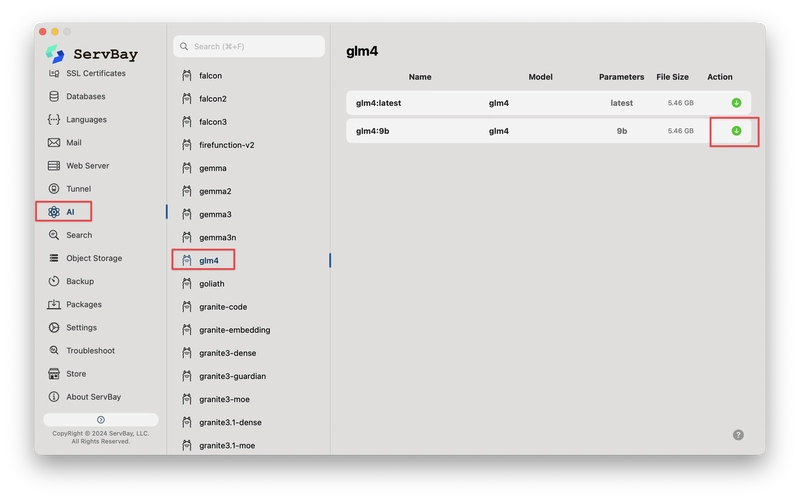

Cũng thông qua ServBay, bạn có thể tải và cài đặt Ollama chỉ với một cú click. Sau đó, cứ lướt menu bên trái, chọn một con Large Language Model (LLM) vừa mắt rồi ấn tải về.

Bản thân OpenClaw ban đầu chưa có khả năng "tự suy nghĩ", nó cần kết nối với Ollama thông qua lệnh sau:

ollama launch openclaw

Lệnh này sẽ config để OpenClaw xài các model do Ollama ở local cung cấp.

Đặt an toàn lên hàng đầu: Lấy Git làm "phao cứu sinh" và Kiểm soát quyền

Khi một con AI nắm trong tay quyền thao tác hệ thống, rủi ro bảo mật cũng tự động tăng theo cấp số nhân. Chắc anh em cũng không lạ gì mấy vụ đọc tin tức OpenClaw lỡ tay xóa sạch hộp thư email của người dùng.

Một con Agent có quyền thực thi lệnh có thể phá nát hệ thống nếu nó hiểu sai chỉ thị. Để chống lại những thảm họa tiềm ẩn này, chúng ta phải có cơ chế phòng thủ thép.

Dùng Git làm lưới an toàn

OpenClaw khuyến cáo anh em nên đưa toàn bộ workspace (bao gồm cả file config và log bộ nhớ) vào quản lý bằng Git.

git init git add AGENTS.md SOUL.md memory/ git commit -m "Khởi tạo workspace cho Agent"

Nếu con Agent cài nhầm một kỹ năng (skill) bị lỗi khi làm task, hoặc tự ý sửa bậy file cấu hình, bạn chỉ cần dùng git revert để quay ngược trạng thái hệ thống về cột mốc an toàn trước đó. Việc version hóa này giúp hành vi của AI trở nên minh bạch và hoàn toàn có thể cứu vãn được.

Giới hạn quyền và Chế độ Sandbox

Sức mạnh của Agent đến từ hệ thống skill của nó. Để ngăn chặn các skill của bên thứ ba chèn mã độc, bạn nên tự tay review mã nguồn và kiểm tra kỹ các câu lệnh nó sẽ thực thi trước khi cài. Ngoài ra, với những con Agent phải xử lý các task phức tạp, tốt nhất là nên nhốt nó vào các môi trường cách ly (isolated) như Máy ảo (VM) hoặc Docker container.

Xác thực danh tính và Truy cập nội bộ

Service Gateway tuyệt đối không được phơi mặt trực tiếp ra public internet. Cách làm chuẩn an toàn là bật xác thực cho gateway, đồng thời chạy lệnh openclaw doctor để chẩn đoán rủi ro. Khi cần truy cập từ xa, hãy kết hợp với VPN hoặc các tool tạo tunnel nội bộ để đảm bảo chỉ có những ai được cấp quyền mới có thể gửi lệnh cho Agent của bạn.

Lời kết

OpenClaw thực sự rất tuyệt. Lấy về làm đồ chơi thì vui, nhưng nếu muốn nó làm một nhân viên cày cuốc 24/24, thì chi phí Cloud và rủi ro vận hành vẫn là quá lớn. Mang nó về chạy Local với Ollama và nhốt vào môi trường Sandbox mới là con đường phát triển đường dài thông minh và bền vững nhất.

All rights reserved